在最新发布的研究论文中,Apple 研究人员详细介绍了 MM1,这是一个新的多模态大语言模型 (MLLM) 系列。

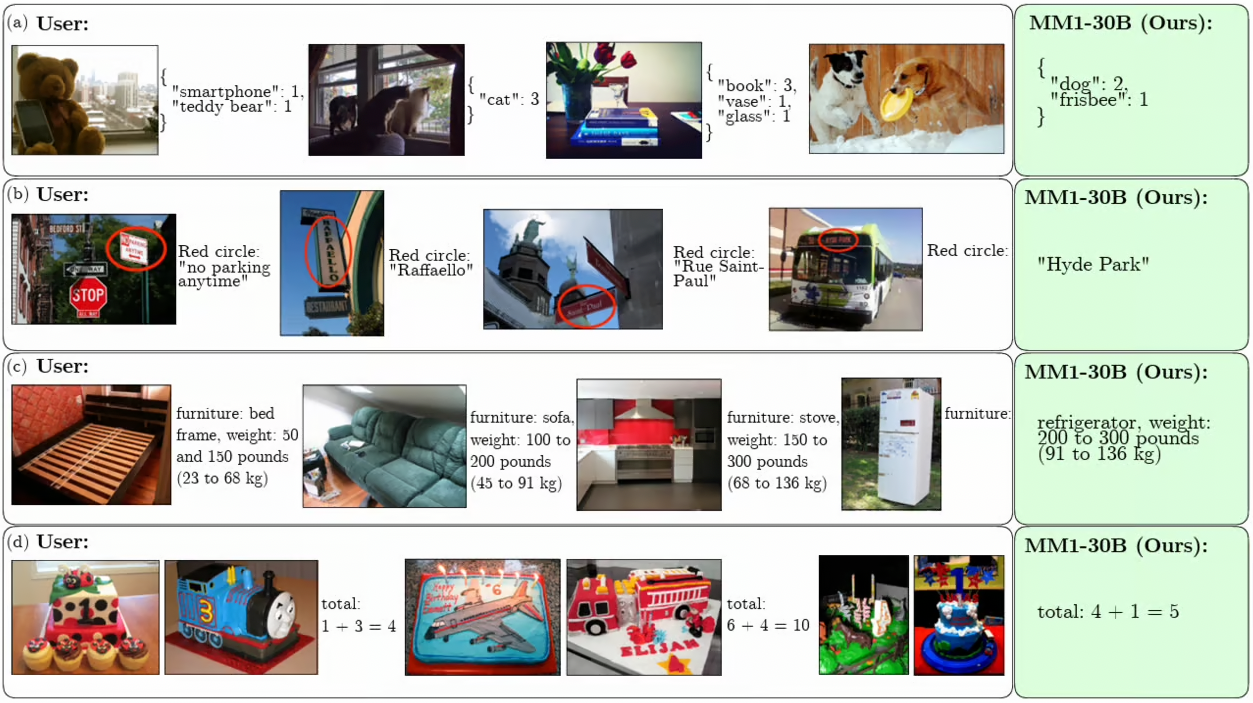

该论文展示了一种使用图像和文本等合成数据训练多模态模型的新方法。

MM1最大的模型有300亿个参数,远小于GPT-4和Claude 3 Opus,后者超过一万亿个参数。

然而,苹果的研究人员声称,MM1 在关键基准测试中可以与他们相媲美,突显出卓越的提示理解能力,可以减少后续提示的数量以达到预期的结果。

虽然该论文没有明确提及 Siri,但对性能、即时效率和多模式功能的关注强烈暗示了 MM1 为下一代苹果虚拟助手提供动力的潜力。

此外,彭博社最近的消息表明,苹果可能计划将Gemini 引入 iPhone。这些进展表明,苹果首席执行官所承诺的期待已久的人工智能突破可能指日可待。

酷COOL~~~